Unendliche Webdaten für Machine Learning

Web Scraping macht das Sammeln riesiger Trainingsdaten einfach – je komplexer Ihr KI-Modell, desto mehr Daten benötigen Sie. Für Vielfalt und Umfang sind skalierbare Scraper unerlässlich. XCrawl liefert Tools und Know-how, damit Sie schnell an Daten kommen.

Wie Unternehmen ScraperAPI für Machine Learning nutzen

Trainieren Sie KI-Modelle und LLMs mit umfangreichen, vielfältigen Webdaten

Trainieren Sie Ihre KI-Modelle effektiv, indem Sie große und vielfältige Datensätze aus Millionen von Webquellen sammeln.

Steigern Sie die Daten-Skalierbarkeit und optimieren Sie den Datenerfassungsprozess für das Training von KI-Modellen mit großen Datenmengen.

Verbessern Sie die Zuverlässigkeit und Genauigkeit der Trainingsdaten Ihrer KI-Modelle, indem Sie einfach hochwertigen Datenzugriff aus Tausenden von Webquellen erhalten.

Verbesserte Modellgenauigkeit und -leistung

Verbessern Sie die Genauigkeit und Leistung Ihrer Modelle in verschiedenen Szenarien, indem Sie die Datenerfassung und -bereinigung im großen Maßstab automatisieren.

Ermöglichen Sie Ihren Modellen, komplexe Muster und Zusammenhänge zu erkennen, indem Sie mehr hochwertige Webdaten nutzen und somit Genauigkeit und Robustheit steigern.

Minimieren Sie Rauschen und Verzerrungen in den Trainingsdaten und bauen Sie zuverlässigere und vertrauenswürdigere KI-Modelle.

Skalieren Sie die Komplexität Ihres Modells mit mehr Daten

Erweitern Sie die Grenzen der KI-Modellleistung und experimentieren Sie mit komplexen Modellarchitekturen wie Deep-Learning-Netzwerken oder Ensemble-Methoden.

Erleichtern Sie iteratives Experimentieren und Optimieren von Modellparametern und Hyperparametern.

Entdecken Sie tiefere Einblicke und Muster in den Daten.

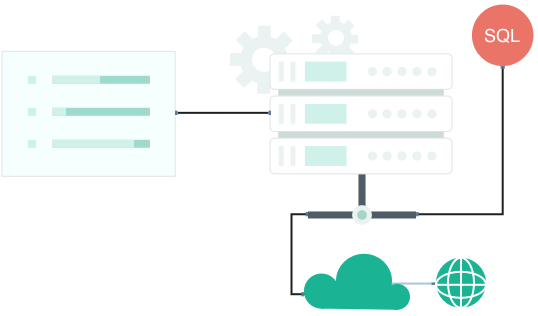

3 Schritte, um Daten für Machine Learning zu erhalten

Schritt 1: Initiieren Sie eine API-Anfrage und übergeben Sie die Informationen der zu verarbeitenden Webseite über eine einfache URL.

Schritt 2: Der Server verarbeitet Seitendaten und gibt strukturierte Daten zurück (wie JSON, CSV usw.).

Schritt 3: Analysieren der Daten, Auswertung der gewünschten Informationen und anschließende Analyse oder Präsentation.

"Ich nutze XCrawl für die automatische Sammlung und Extraktion von Social-Media-Daten. Die Integration mit Zapier, Make & n8n spart Zeit, Geld und bringt tolle Ergebnisse. Für Datenextraktion empfehle ich es jedem."

Warum XCrawl?

Zuverlässiger Zugriff im großen Maßstab Jeder Plan (einschließlich des kostenlosen Plans) wird mit XCrawl Proxy geliefert, der entwickelt wurde, um Anfragefehler zu reduzieren und den Zugriff auf geografisch spezifische Inhalte zu unterstützen. | Kunden lieben uns Wir kümmern uns wirklich um die Zufriedenheit unserer Nutzer und sind deshalb eine der am besten bewerteten Datenextraktionsplattformen auf G2 und Capterra. | Überwachen Sie Ihre Läufe Mit unseren neuesten Überwachungsfunktionen haben Sie immer sofortigen Zugriff auf wertvolle Einblicke in den Status Ihrer Web-Scraping-Aufgaben. |

Export in verschiedene Formate Ihre Datensätze können in jedes Format exportiert werden, das zu Ihrem Daten-Workflow passt, einschließlich Excel, CSV, JSON, XML, HTML-Tabelle, JSONL und RSS. | Integrieren Sie XCrawl in Ihren Workflow Sie können Ihre XCrawl-Läufe mit Plattformen wie Zapier, Make, Keboola, Google Drive oder GitHub integrieren. Verbinden Sie sich mit praktisch jedem Cloud-Service oder jeder Web-App. | Für Entwickler gebaut XCrawl wird von einem erfahrenen Engineering-Team entwickelt, mit fortlaufendem technischen Support über unsere Discord-Community. |

Zuverlässiger Zugriff im großen Maßstab Jeder Plan (einschließlich des kostenlosen Plans) wird mit XCrawl Proxy geliefert, der entwickelt wurde, um Anfragefehler zu reduzieren und den Zugriff auf geografisch spezifische Inhalte zu unterstützen. |

Kunden lieben uns Wir kümmern uns wirklich um die Zufriedenheit unserer Nutzer und sind deshalb eine der am besten bewerteten Datenextraktionsplattformen auf G2 und Capterra. |

Überwachen Sie Ihre Läufe Mit unseren neuesten Überwachungsfunktionen haben Sie immer sofortigen Zugriff auf wertvolle Einblicke in den Status Ihrer Web-Scraping-Aufgaben. |

Export in verschiedene Formate Ihre Datensätze können in jedes Format exportiert werden, das zu Ihrem Daten-Workflow passt, einschließlich Excel, CSV, JSON, XML, HTML-Tabelle, JSONL und RSS. |

Integrieren Sie XCrawl in Ihren Workflow Sie können Ihre XCrawl-Läufe mit Plattformen wie Zapier, Make, Keboola, Google Drive oder GitHub integrieren. Verbinden Sie sich mit praktisch jedem Cloud-Service oder jeder Web-App. |

Für Entwickler gebaut XCrawl wird von einem erfahrenen Engineering-Team entwickelt, mit fortlaufendem technischen Support über unsere Discord-Community. |

Häufig gestellte Fragen

Alles, was Sie über XCrawl wissen müssen.

Was ist XCrawl?

XCrawl ist eine KI-bereite Web-Scraping-API, die Webseiten in strukturiertes JSON, Markdown, HTML und Screenshots umwandelt. Für Entwickler sind integrierte Proxys, Crawling und SERP-Daten enthalten.

Wodurch unterscheidet sich XCrawl von anderen Web-Scraping-Tools?

Traditionelle Scraper liefern oft rohes HTML. XCrawl liefert sauberes JSON und Markdown sowie integrierte Proxy-Rotation, SERP-API und Integrationen mit MCP, n8n und Zapier für schnellere Produktions-Workflows.

Ist XCrawl kostenlos testbar?

Ja. Jedes neue Konto enthält 1.000 kostenlose Credits, ohne dass eine Kreditkarte erforderlich ist. So können Sie Scraping, Crawling, SERP-Daten und KI-bereite Ausgaben vor dem Upgrade testen.

Kann XCrawl JavaScript-lastige Webseiten scrapen?

Ja. XCrawl nutzt Headless-Browser-Rendering, um SPAs, unendliches Scrollen und dynamische Client-Seiten zu verarbeiten; die Daten werden nach dem Laden der Schlüsselelemente extrahiert.

Welche Ausgabeformate unterstützt XCrawl?

XCrawl liefert strukturiertes JSON, KI-bereites Markdown, rohes HTML und Screenshots. Nutzen Sie JSON für Systemintegration und Markdown für token-effiziente LLM-Workflows.

Mit welchen Programmiersprachen kann man XCrawl nutzen?

XCrawl ist eine REST-API und funktioniert mit jeder Sprache. Offizielle SDKs gibt es für Python und Node.js/TypeScript, Beispiele für Go, Ruby, PHP und cURL sind verfügbar.

Funktioniert XCrawl mit KI-Agenten und Automatisierungstools?

Ja. XCrawl unterstützt MCP für Claude sowie n8n, Zapier, Make und eigene Pipelines, damit KI-Agenten in Echtzeit auf aktuelle Webdaten zugreifen können.

Wie kann ich mit XCrawl starten?

Erstellen Sie ein kostenloses Konto auf xcrawl.com, kopieren Sie Ihren API-Schlüssel aus dem Dashboard und senden Sie Ihre erste Anfrage. Sie erhalten 1.000 kostenlose Credits und Schnellstart-Beispiele für Python, Node.js und cURL.

Wie funktionieren Preise und Credits bei XCrawl?

Jede Anfrage verbraucht Credits je nach Komplexität. Standardseiten, SERP-Anfragen und fortgeschrittene Funktionen verbrauchen unterschiedlich viele Credits. Prüfen Sie die Preisseite für die aktuelle Credit-Tabelle.

Brauche ich Programmierkenntnisse, um XCrawl zu nutzen?

Nein. Sie können XCrawl über No-Code-Plattformen wie n8n und Zapier verwenden oder SDKs und REST-Aufrufe für fortgeschrittene Entwickler-Workflows nutzen.